フェイクニュースを探せ! 早く、正しく、納得の結果を出すAI

不適切なネット情報を検出するAI

インターネット上の情報には、フェイクニュース、ネットいじめ(ヘイトスピーチ)、生成AIのハルシネーション(誤った回答)も含まれています。こうした不適切な情報を放置すると、偽の情報を信じて誤った判断をしたり、傷つく人が増えたりと、社会に悪影響を与えてしまいます。そこで、大規模言語モデル(LLM)ベースのAIによるテキストマイニングで、自動的に不適切な情報を抽出するAIモデルの開発が進んでいます。

素早く、正確に見つける

不適切な情報を検出する際、正確さとスピードの両立が必要です。フェイクニュースが拡散されないように、早い段階で見つけることは重要なのです。

フェイクニュースを検出するAIは、過去の正しいニュースと偽のニュースを学習して判断します。新たに開発された手法では、例えば「このニュースはおかしい」などのSNSの投稿も判断材料に加えて、正確性が高められています。しかし、批判の投稿を待つ間にもフェイクニュースは広がります。そこで、ウェブ上にニュースが発表されてから一定時間ごとに「真偽の確率」を出すという手法が使われています。一定の確率を超えた時のみ、真偽を断定するのです。これにより、批判の投稿が増えるにつれて確率が上がっていくことがわかりました。

判断基準を明確にした信頼できるAI

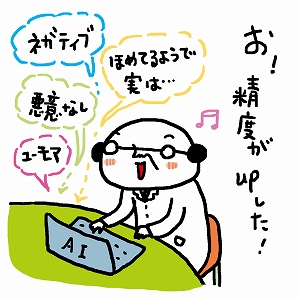

AIは間違うこともあるので、AIには「説明可能性(判定の根拠)」も重要です。そこで、新しく開発されたネットいじめの検出AIでは、あらかじめ学習させた悪意ある単語が判定にどのように使われたか、判定の根拠がわかる機能が追加されました。学習させるデータには、ネガティブな意味の単語だけでなく、一見褒めているようで実は悪意がある皮肉や、一見ネガティブでも悪意はないユーモアも含まれます。さらに、その人の特性によってどんな言葉に傷つくかが変わるため、性別、人種など、対象グループの情報を与えたところ、判定の精度、説明可能性ともに向上しました。

※夢ナビ講義は各講師の見解にもとづく講義内容としてご理解ください。

※夢ナビ講義の内容に関するお問い合わせには対応しておりません。

先生情報 / 大学情報